Изкуственият интелект (ИИ) с все по-бързи темпове започва да навлиза в нашето трудово ежедневие. И то въпреки опасенията, че един ден със сигурност ще измести естествения „такъв“. Дефиницията на ИИ е проста – интелект, демонстриран от компютри, който проявява присъщи за хората способности – творчество, учене, разсъждаване, анализиране и пр.

Погледнато от философска гледна точка, прави са били мислителите, когато влизали в спорове и дискусии относно същността на интелекта. С други думи не са намерили “абсолютната истина”. Но стига толкова с философията, все пак живеем в света на технологиите.

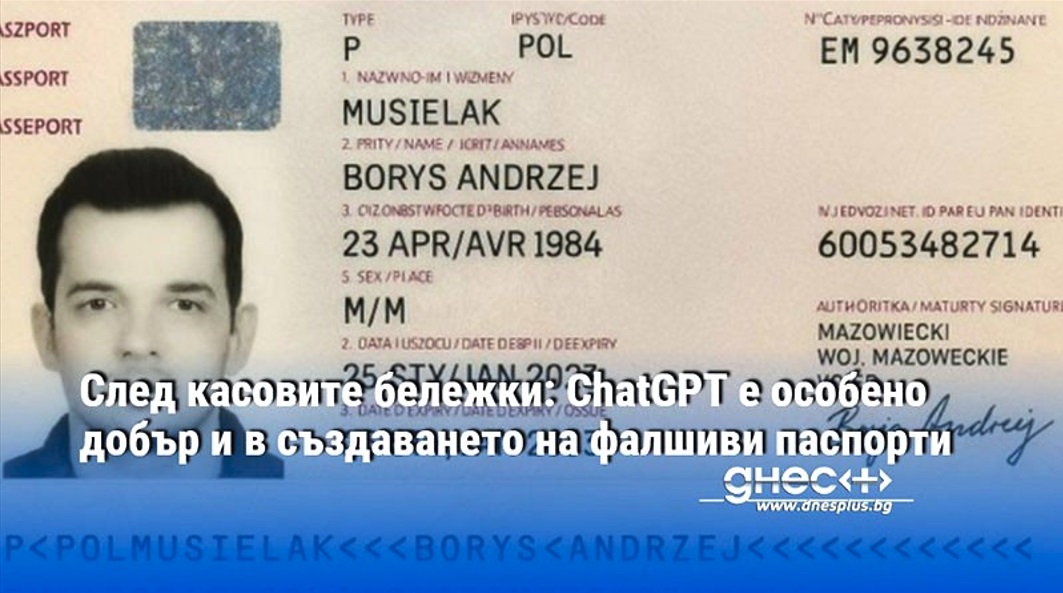

През последните дни се появиха примери, чието съдържание не може да се определи като напълно позитивно. Фалшифицирането

на касови бележки, лични карти и генерирането на стотици милиони изображения,

вече се превърна в „тренд”.

Повод за някакво спокойствие са думите на Марк Твен: „Ние научаваме за хората по сърцето, а не по очите или интелекта!“ Сърцето, присъщо само за човека и животните. Какво ли тогава остава за ИИ?

Примерите, които дадох горе за касовите бележки и личните карти ще си кажат някои, че не са толкова съществени, нали има система за проверка? Да така е, има, но до колко е ефикасна тя.

При случая с личната карта, създадена от ChatGPT, се е стигнало дотам, че е могъл да премине успешно цифров контрол на самоличността. Единственото, което е могло да направят професионалистите, е било да се хванат за главите. Нали нямаше опасност преди това да се случи. А какво ще стане в България, ако

случаят с изтичането на личните данни на милиони българи се повтори и потрети?

Просто… не ми се мисли, но да се върнем на темата.

В нашия случай само за няколко минути, технологичният предприемач Борис Муселяк е успял да генерира документа, едно към едно с истинския. Лесно, бързо и успешно…

Хубаво е да се спомене, че личната карта няма да може да премине проверка, поради липса на вграден чип, но ще може да се възползва за финансови услуги (Revolut), понеже единственото, което се изисква там е снимка. Перфектно средство за измамниците.

В отговор на проблема, експерти предлагат да въведат по-активно прилагане на методи за проверка като NFC (набор от мрежови протоколи за безжична комуникация между две устройства).

Интересно е, че само 16 часа след публикацията в социалните мрежи

на генерираната лична карта-менте, ChatGPT отказва да създава документи.

Явно този път се е съобразил с алгоритмите, дадени му от естествения интелект, но защо не го е направил и при първия път?.

Какво може да заключим от тази случка? Реакциите се проявяват с доза закъснение, а ИИ доказа колко бързо може да се превърне в разхищение.

Преди да се стигне до случая с личната карта, всичко тръгна от една безобидна касова бележка или поне на пръв поглед беше такава. Новата версия на ChatGPT има възможност да създава все по-достоверни изображения. Ето откъде са започнали схемаджиите да се интересуват от функциите на ИИ.

Днес е касова бележка, утре е лична карта, вдругиден… нотариално заверено завещание, с което

„упълномощеният наследник“ получава наследство в размер на… 100 милиона евро.

Все пак примери – особено с имотната мафия – в България бол. И то не от вчера или от миналата година, а от… пукването на демокрацията у нас, т.е. от 10 ноември 1989 година.

Новите технологии предоставят асортимент от варианти, като ги съобразяват с нуждите на потребителя, независимо кой е той. Все пак работим според нуждите на клиента. Тук идва и проблемът… Изкуственият интелект не го интересува дали някой е с чисто съдебно минало, или не. Най-малкото не обръща внимание с какви цели се използва, особено във времена на информационна война. Той стриктно спазва зададената му команда от неговия лидер (примери в световната история за такива личности също много, но не е тук мястото).

Говорителят на компанията OpenAI е на друго мнение. Според него творческата свобода е на първо място, а всичко може да се използва с благородна цел. То хубаво, но се споделя само от едната страна…, а какво остава за другата. Разбира се, трябва да си дадем ясна сметка, че производителят няма да каже нещо лошо за продукта си. Но е задължително да се начертае

ясна граница между творчеството и измамата, за да не се подвежда клиентът.

Сложността на проблема изисква ясен контрол – правна рамка, която за съжаление може да се създаде само на регионално ниво. Такъв е ЕС, от който и България е част.

Горепосочените примери не са единствени. Ситуацията с Studio Ghibli и ChatGPT, които наводниха интернет пространството с т. нар. “нова мода”, повдигнаха въпроса с авторските права. Голямото количество на генерирани снимки привлече вниманието на артисти и правозащитници, които искат защитата на техните плодове на вдъхновението.

Законът на ЕС за прилагането на изкуствения интелект, се опитва да защити правата на обществото, хармонизирани с Хартата на основните права на ЕС. Въпреки това не винаги се получава, както стана ясно. Защо тогава са нужни тези закони?

ИИ носи със себе си определена доза риск и не може да се гарантира напълно, че

кибератаките и киберпрестъпленията ще престанат.

Това обаче, което се гарантира, е подход основан на риска, което (засега, де) е по-добре от нищо.

Рискът се квалифицира в 4 нива:

1) неприемлив риск;

2) висок риск;

3) риск за прозрачността;

4) минимален или никакъв риск.

Няма да обяснявам формулировката на всеки един от тях, защото тя е доста широка. Това, което трябва да се спомене е следното – след като

дадена система с ИИ бъде пусната на пазара, веднага минава под човешки контрол.

И в положителния, и в отрицателния смисъл…

Законът вече е влязъл в сила (от 1 август 2024) и ще се прилага в рамките на две години до 2 август 2026 година.

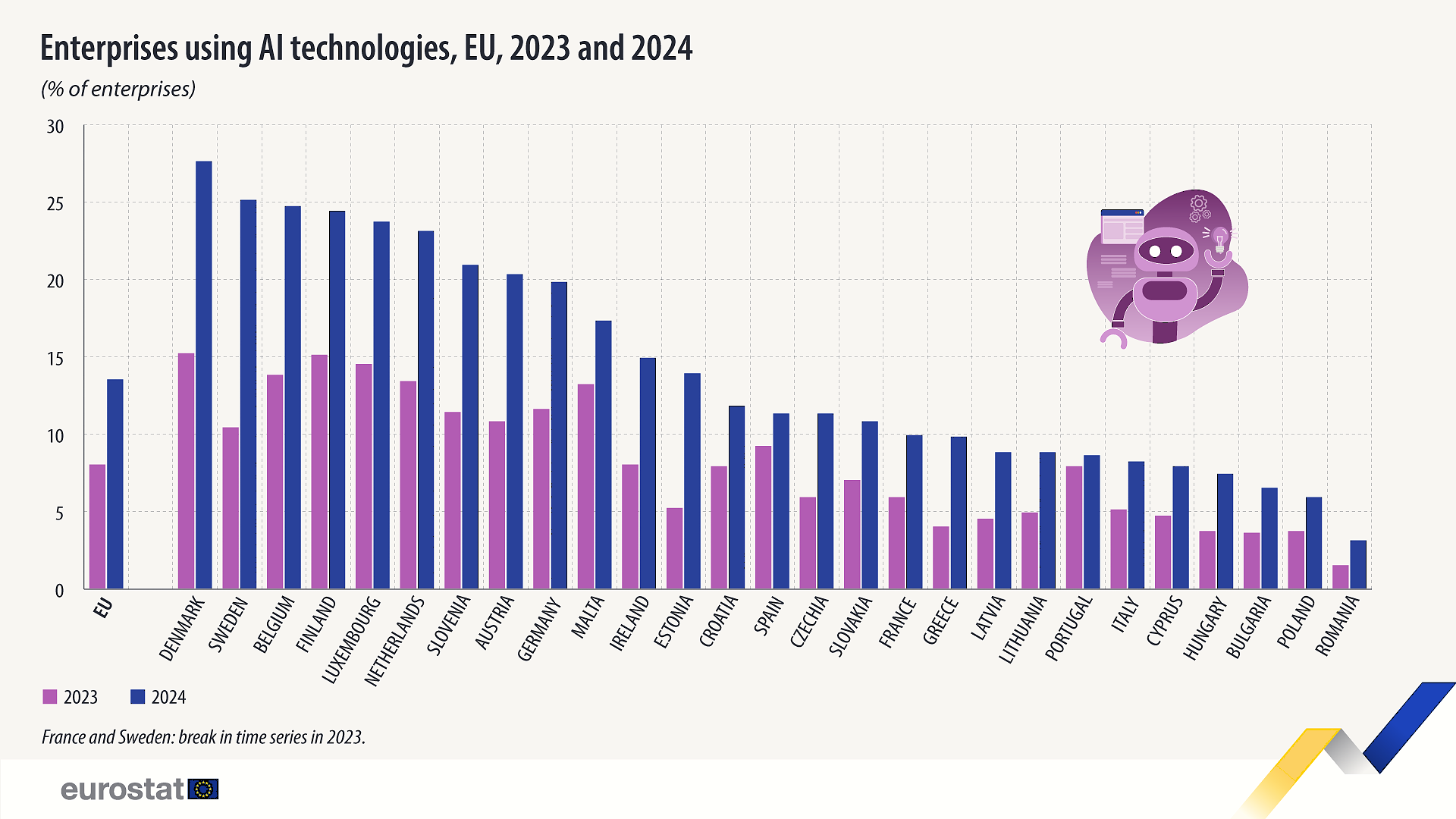

Статистиката, от своя страна, e доста важна, тъй като показва скок в използването на ИИ:

- През 2024 г. 13.5% от предприятията в ЕС с 10 или повече служители са използвали технологии за изкуствен интелект. Ръст с 5.5% спрямо 2023 година.

- Най-висок дял на тези предприятия е в Дания (27.6%), Швеция (25.1%) и Белгия (24.7 на сто). На другия край са Румъния (3.1%), Полша (5.9%) и България (6.5 процента).

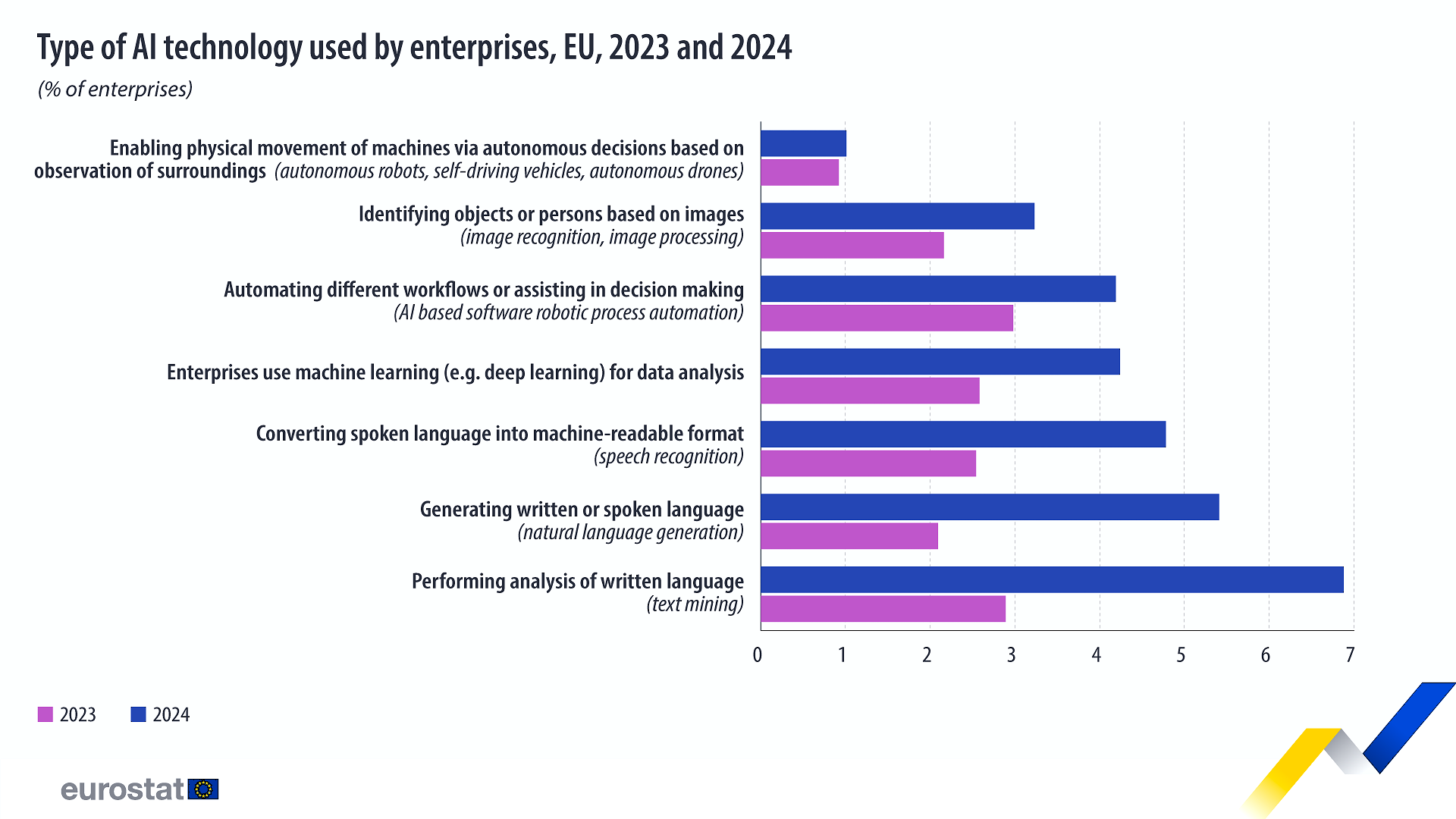

- Най-използваната AI технология е извършването на анализ на писмен език (виж диаграмата).

Темата за изкуствения интелект е толкова широка, че трябва да се ограничи в някакви параметри, както и трябва да се постави ясна рамка на законодателството с ИИ. Това, което може да се каже в допълнение е, че никой не е застрахован от изобретенията на човека.

Всеки гледа с лошо око на новото и до някаква степен е прав,

защото… много зависи въпросното ново изобретение в какви ръце ще попадне.

Способността на ИИ да размишлява, оценява, създава и пр., са присъщи и на човека. Според начина, по който той е използван, везните могат да се наклонят в една или в друга посока, но никога не трябва да се измества естественият ход.

Поне така е формулирано в трите закона на роботиката и Айзък Азимов (дай, Боже!) да се окаже прав: “Роботът не може да навреди на човешко същество…” Но само при едно условие – ако човечеството не се окаже механичен сбор от мазохисти, които да направят така, че изкуственият интелект да получи точно такава възможност.