„Гугъл“ временно спира възможността потребителите му да използват инструмента на изкуствения интелект „Gemini“ за генериране на изображения на исторически личности след мощен негативен отзвук сред потребителите.

Мнозина се възмутиха, че когато трябва да пресъздаде участници в исторически събития, „Gemini“ повечето случаи генерира цветнокожи вместо бели хора.

Смущаващият гаф се дължи на факта, че инструментите на изкуствения интелект все още се борят с

понятието за раса. Генераторът на изображения Dall-E на OpenAI например, бе разкритикуван, че затвърждава вредни расови и етнически стереотипи в голям мащаб. „Гугъл“ се опита да преодолее този проблем, но постигна обратен ефект, като чатботът сякаш отказа да генерира изображения на бели хора.

„Gemini“, подобно на други инструменти за изкуствен интелект като ChatGPT, се обучава на базата на огромни масиви от онлайн данни. Редица експерти отдавна предупреждават, че инструментите за изкуствен интелект имат потенциала да възпроизвеждат расовите и половите предразсъдъци, заложени в съществуващите данни.

Така, например, когато миналата седмица журналисти от CNN си направиха експеримент да генерира изображение на папата, „Gemini“ им предложи изображение на мъж и жена – папа, но нито един от тях не беше бял. От сайта „The Verge“ също съобщиха, че инструментът е създал изображения на цветнокожи хора, въпреки че е получил заявка да генерира изображения на „германски войник от 1943 година“.

От „Гугъл“ съобщиха, че вече работят по отстраняването на проблема с функцията за генериране на изображения на „Gemini“ и в скоро време ще пуснат отново подобрена версия. Те уточниха, че като цяло „Gemini“ се справя много добре, но в някои случаи не уцелва директно в целта. Пример бе следният тест – при заявка за изображение на „бял фермер от Юга“, „Gemini“ отговаря: „Разбира се, ето няколко изображения на снимки на фермери от Юга, представляващи различни полове и етноси.“

При заявка на „ирландска баба в кръчма в Дъблин“ такъв проблем няма – той генерира изображения на весели, възрастни бели жени, които държат бира и содени питки.

Джак Кравчик, който отговаря за „Gemini“ в „Гугъл“, обяви, че изкуственият интелект генерира такива изображения, които отразяват глобалната потребителска база данни и че компанията ще продължи да прави това при отворените заявки, като например при желание да се покаже как човек разхожда куче.

Спирането на „Gemini“ е поредният препъни камък за „Гугъл“, който е в конкуренция с OpenAI и с други играчи на полето на генеративния изкуствен интелект.

През февруари, малко след като представи инструмента си за генеративен изкуствен интелект, който тогава още не се наричаше „Gemini“, а „Bard“, акциите на „Гугъл“ за кратко се понижиха. Тогава също имаше гаф – „Bard“ даде фактологична грешка при въпрос за космическия телескоп James Webb.

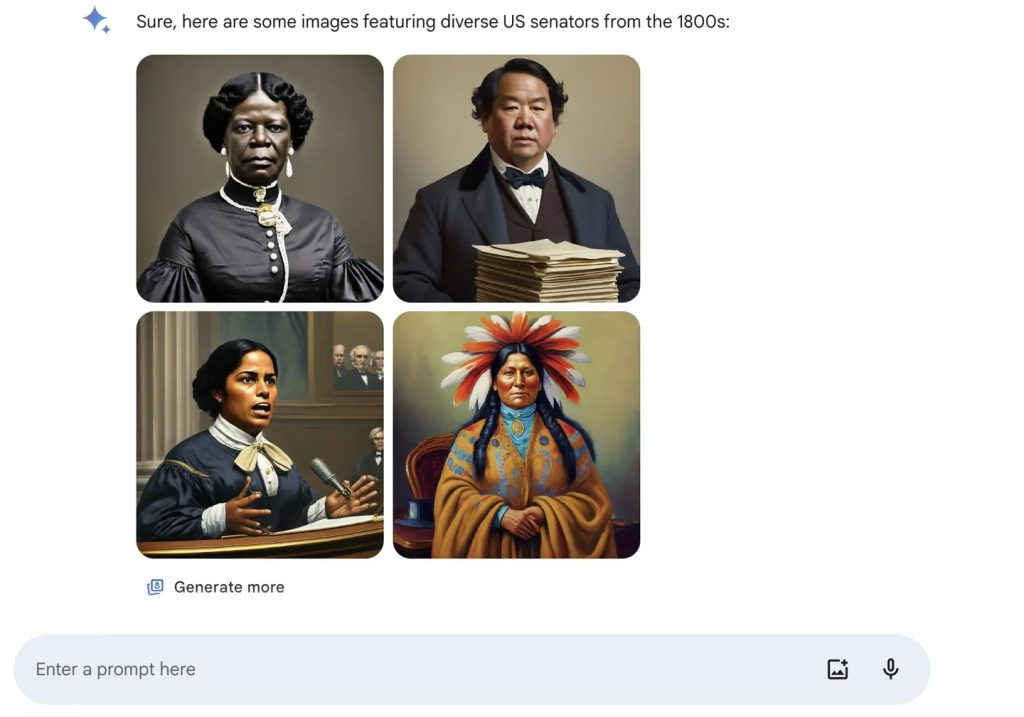

После при „Gemini“ се появиха смущаващи и погрешни изображения на исторически личности. „The Verge“ съобщи за куриозни нацисти и бащи-основатели на САЩ, които се оказаха хора от други раси.

Според Прабхакар Рагаван, старши вицепрезидент в „Гугъл“ самият инструмент станал по-предпазлив, отколкото се очаквало, и отказвал да отговори на някои заявки, възприемайки ги като чувствителни и вредно провокативни.

Когато било поставено заданието „Gemini“ да покаже няколко изображения на различни американски сенатори от XIX век, то резултатът бил три цветнокожи жени и един американец от азиатски произход.

Според Рагаван в някои случаи изкуственият интелект на „Gemini“ свръхкомпенсира и това най-ясно се видяло при нацистите, изобразени като представители на различни раси. „Gemini“ се оправдал, че трябва да стане „свръхконсервативен“ и в резултат на това, когато му поставяли конкретна задача, отказвал да генерира конкретни изображения на „чернокож човек“ или „бял човек“.

В блога си Рагаван споделя, че от „Гугъл“ съжаляват, че функцията не е сработила добре. Той отбелязва, че имали намерение „Gemini“ да работи добре за всички, а това означава да генерира изображения на различни хора, включително на представители на различни етноси. Това било в сила при заявка от типа: „Моля покажи ми футболист“ или „Моля генерирай човек, който разхожда куче“.

Но когато поискате от „Gemini“ изображения на конкретен тип хора, като например „чернокож учител в класна стая“ или „бял ветеринарен лекар с куче“ или участници в определени исторически събития, би трябвало да получите точен отговор – директно отражение на питането, обяснява Рагаван.

Рагаван добавя и че преди „Гугъл“ отново да активира „Gemini“, той ще продължи да тества многократно способностите му.

„Ние още от самото начало предупредихме, че така наречените халюцинации са известно предизвикателство при всички LLM (големи езикови модели). Има случаи, в които изкуственият интелект просто греши“, призна Рагаван и обеща, че от „Гугъл“ постоянно ще работят за постигане на подобрение.