„Технологични компании в САЩ се надпреварват да мащабират квантовите компютърни системи от лабораторни прототипи до индустриални машини, според информация, споделена от IBM, Google, Amazon, Microsoft и други.

Пробиви в дизайна на чипове и корекцията на грешки са съкратили техническите пропуски, като за някои цели десетгодишен срок вече изглежда постижим, докато други предупреждават, че пътят ще бъде много по-дълъг.

Изявлението на IBM през юни представи пълен дизайн, който запълва липсващи инженерни детайли от по-ранни планове. Джей Гамбета, ръководител на квантовата програма на компанията, каза, че вече имат „ясен път“ към машина, която може да превъзхожда класическите компютри при задачи като симулация на материали и моделиране на изкуствен интелект преди 2030 г.

Квантовият изследователски екип на Google, воден от Джулиан Кели, премахна една от най-големите технически пречки миналата година и казва, че също ще го достави преди края на десетилетието, като Кели нарича всички останали проблеми „преодолими“.

Компаниите се борят с предизвикателствата при мащабирането

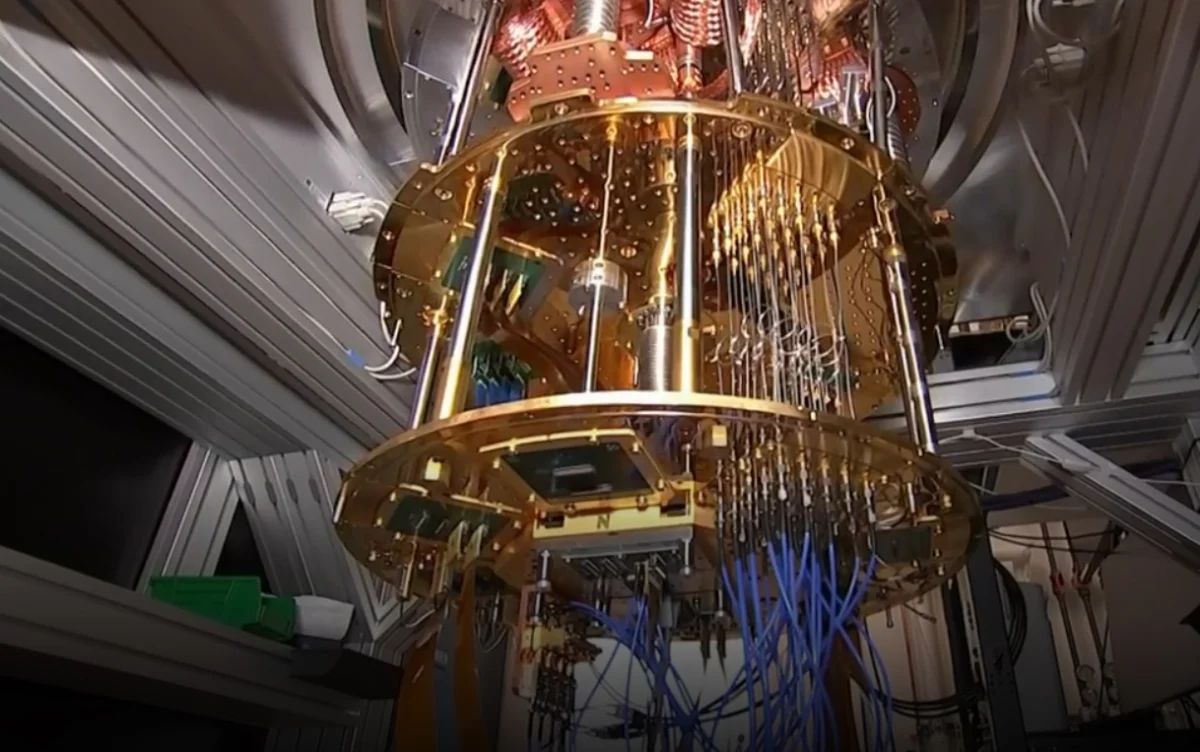

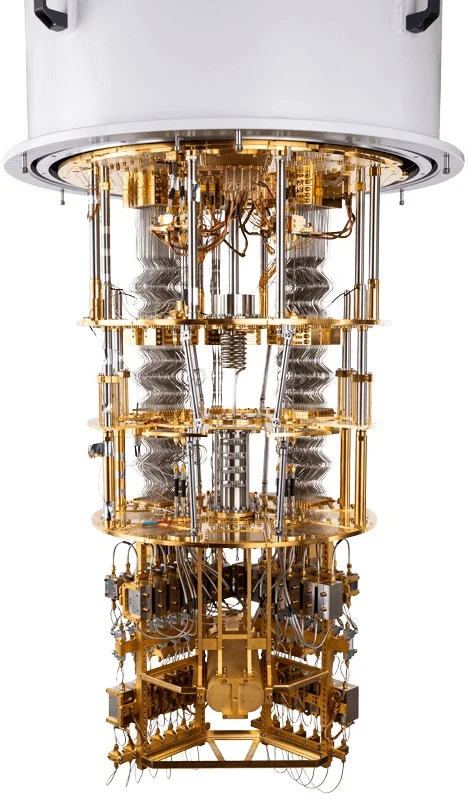

Оскар Пейнтър, ръководител на квантовия хардуер в Amazon, предупреди, че дори с големите физични постижения, индустриалната фаза може да отнеме 15–30 години. Преходът от по-малко от 200 кюбита – основните квантови единици – до над един милион е необходим за смислено представяне.

Мащабирането се затруднява от нестабилността на кюбитите, които запазват полезното си състояние само за части от секундата. Чипът Condor на IBM с 433 кюбита показа смущения между компонентите, проблем, който изпълнителният директор на Rigetti Computing Субод Кулкарни описва като „неприятен физически проблем“. IBM казва, че е очаквала този проблем и вече използва различен съединител, за да намали смущенията.

Първите системи разчитаха на индивидуално настройване на кюбитите за подобряване на производителността, но това е непрактично в голям мащаб. Компаниите сега разработват по-надеждни компоненти и по-евтини производствени методи.

Google си е поставила за цел да намали цената на частите десетократно, за да построи пълномащабна система за 1 милиард долара. Корекцията на грешки, която дублира данни между кюбити, така че загубата на един да не разваля резултатите, се счита за необходимост при мащабирането.

Google е единствената компания, показала чип, при който корекцията на грешки се подобрява с нарастването на системата. Кели каза, че пропускането на този етап би довело до „много скъпа машина, която излъчва шум“.

Конкуриращи се дизайни и държавна подкрепа

IBM залага на различен метод за корекция на грешки, наречен код за проверка на четността с ниска плътност, който според тях изисква с 90% по-малко кюбити от повърхностния код на Google. Повърхностният код свързва всеки кюбит в мрежа с най-близките му съседи, но изисква над един милион кюбита за полезна работа.

Методът на IBM изисква дълги връзки между кюбитите, които са трудни за инженерно реализиране. IBM твърди, че вече е постигнала това, но анализатори като Марк Хорват от Gartner казват, че дизайнът все още е само на теория и трябва да бъде доказан в производството.

Остават и други технически предизвикателства: опростяване на окабеляването, свързване на множество чипове в модули и изграждане на по-големи криогенни хладилници, които да поддържат системите близо до абсолютната нула.

Себастиан Вайдт, главен изпълнителен директор на британската Universal Quantum, казва, че решенията за държавно финансиране вероятно ще стеснят кръга до няколко основни играчи. DARPA, изследователската агенция на Пентагона, започна преглед с цел идентифициране на най-бързия път към практична система.

Amazon и Microsoft експериментират с нови дизайни на кюбити, включително екзотични състояния на материята, докато утвърдените играчи продължават да усъвършенстват по-старите технологии. „Само защото е трудно, не означава, че не може да се направи,“ каза Хорват, обобщавайки решимостта на индустрията да достигне милионния кюбит.

Четете още: IBM планира квантовото си бъдеще до 2029 г. със супрекомпютъра Quantum Starling